Xiaomi MiMo V2 : une plateforme IA complète pour les agents, robots et synthèse vocale

Alors que la course aux modèles de langage s'intensifie, Xiaomi vient de franchir un cap significatif en lançant simultanément trois modèles d'IA sous la bannière MiMo V2. L'objectif affiché est clair : constituer une plateforme complète capable d'alimenter des agents autonomes, des robots et des systèmes de synthèse vocale. Une initiative qui mérite l'attention des développeurs et des entreprises qui suivent l'évolution de l'IA applicative.

Trois modèles pour une plateforme cohérente

Xiaomi ne lance pas un simple modèle de plus sur un marché déjà saturé. La stratégie ici est celle de l'écosystème : trois modèles complémentaires, conçus pour fonctionner ensemble et couvrir l'ensemble des besoins d'une application IA moderne.

MiMo-V2-Pro : le moteur de raisonnement

Le modèle phare, MiMo-V2-Pro, repose sur une architecture Mixture-of-Experts (MoE) avec plus d'un trillion de paramètres au total, dont 42 milliards actifs par requête. C'est environ trois fois la taille de son prédécesseur MiMo-V2-Flash, sorti en décembre 2025.

Malgré ce bond en termes d'échelle, un mécanisme d'attention hybride maintient une efficacité opérationnelle notable, permettant notamment de gérer des fenêtres de contexte allant jusqu'à un million de tokens. Le modèle utilise également une génération multi-tokens simultanée, ce qui améliore sensiblement le débit de génération par rapport à une approche token par token classique.

Sur le plan des performances, MiMo-V2-Pro se rapproche du Claude Opus 4.6 d'Anthropic sur les benchmarks de code et de tâches agentiques, et ce à une fraction du coût d'API. Un positionnement prix/performance qui pourrait séduire les équipes cherchant à intégrer des capacités avancées sans exploser leur budget d'infrastructure.

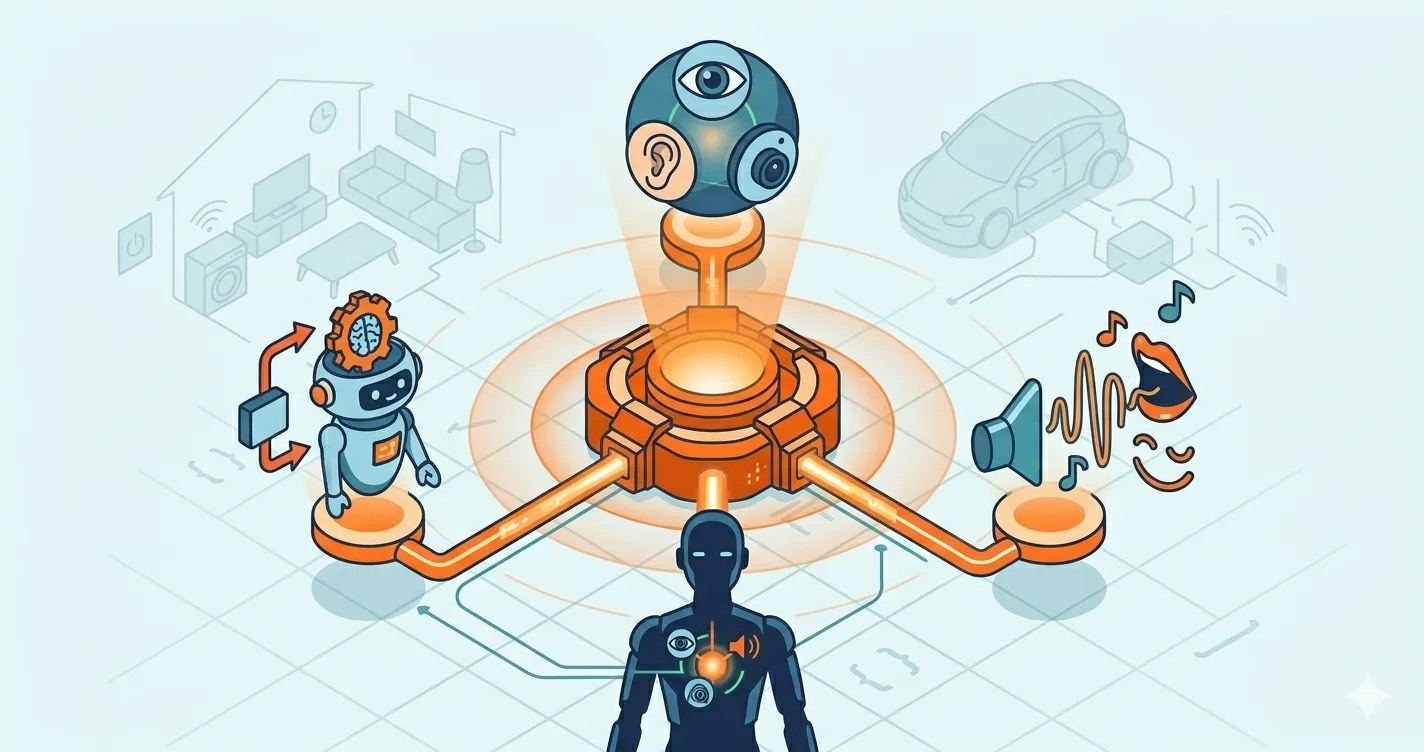

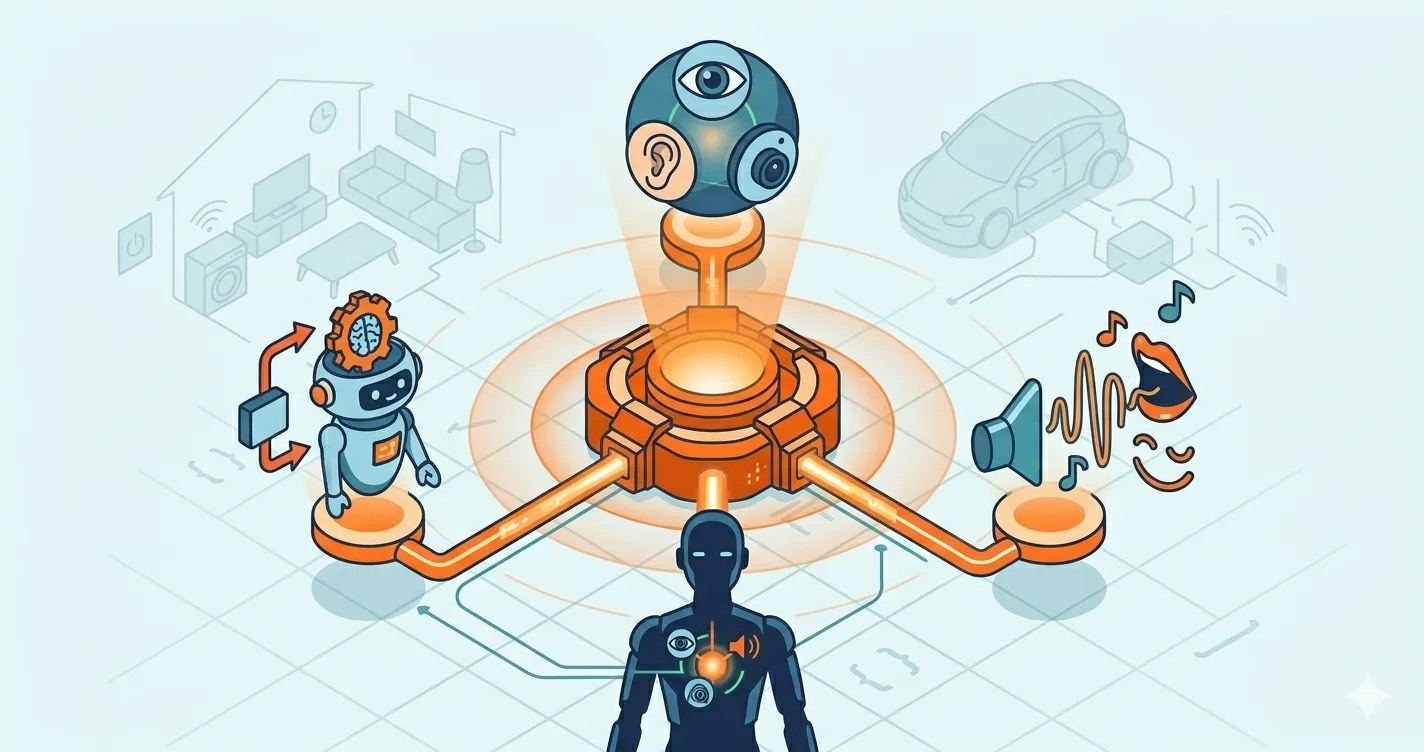

MiMo-V2-Omni : voir, entendre et agir

MiMo-V2-Omni est le modèle multimodal de la famille. Il peut traiter simultanément du texte, des images et de l'audio, et est conçu pour agir de manière autonome dans des environnements logiciels. Parmi les cas d'usage documentés : effectuer des achats dans un navigateur web ou analyser des images de caméras embarquées (dashcam) pour détecter des situations dangereuses.

Cette capacité d'action autonome dans des interfaces graphiques (ce qu'on appelle le "computer use") positionne MiMo-V2-Omni comme un candidat sérieux pour alimenter des agents RPA (Robotic Process Automation) de nouvelle génération, bien au-delà de la simple réponse textuelle.

Le troisième modèle : synthèse vocale

Le troisième volet de la plateforme est dédié à la synthèse vocale, complétant ainsi le triptyque texte / vision-action / voix. Les détails techniques précis sur ce modèle restent encore partiels, mais son intégration dans la suite MiMo V2 souligne la volonté de Xiaomi de proposer une stack IA verticalement intégrée, notamment en vue d'applications embarquées sur ses appareils (smartphones, robots domestiques).

L'affaire "Hunter Alpha" : quand un modèle anonyme bat des records

L'un des aspects les plus intéressants de ce lancement est la manière dont il a été découvert. Avant son annonce officielle, MiMo-V2-Pro a été déployé anonymement sur la plateforme OpenRouter sous le nom de code "Hunter Alpha". Le modèle a rapidement grimpé en tête des classements, avec de nombreux utilisateurs qui, surpris par ses performances, ont cru avoir affaire à un nouveau modèle de DeepSeek.

Cette anecdote est révélatrice à plusieurs niveaux :

- Elle confirme la qualité objective du modèle, validée par une communauté de développeurs sans biais marketing.

- Elle illustre le nouveau standard de référence que DeepSeek a imposé dans l'imaginaire collectif des développeurs IA.

- Elle montre qu'OpenRouter est devenu un terrain de test crédible pour évaluer les modèles en conditions réelles.

Ce que cela signifie pour les développeurs et les entreprises

Pour les équipes qui développent des applications en PHP/Symfony ou dans d'autres stacks web, l'émergence de modèles comme MiMo-V2-Pro soulève des questions concrètes et des opportunités réelles.

Sur le plan du coût d'intégration, la promesse d'un modèle de niveau frontier à un coût d'API réduit est directement pertinente pour les projets qui doivent justifier un ROI. Intégrer des capacités de raisonnement avancé dans une application métier devient plus accessible.

Sur le plan des agents autonomes, MiMo-V2-Omni ouvre des perspectives pour des workflows où l'IA ne se contente plus de générer du texte, mais interagit avec des interfaces, remplit des formulaires, navigue dans des applications. Pour les projets d'automatisation back-office ou de traitement de données à partir de sources visuelles, c'est un changement de paradigme.

Sur le plan architectural, l'approche MoE (Mixture-of-Experts) mérite d'être comprise par les développeurs qui consomment des API IA. Elle explique pourquoi un modèle peut avoir un trillion de paramètres tout en restant économiquement viable à inférer : seule une fraction des paramètres est activée par requête, ce qui réduit considérablement le coût de calcul.

Conclusion

Xiaomi démontre avec MiMo V2 qu'il est possible de construire une plateforme IA cohérente et compétitive, capable de rivaliser avec les meilleurs modèles du marché à un coût maîtrisé. La combinaison d'un LLM performant, d'un modèle multimodal orienté action et d'un système de synthèse vocale constitue une base solide pour les applications de demain : agents autonomes, interfaces conversationnelles et robotique.

Pour les développeurs et les décideurs techniques, la leçon principale est celle-ci : le marché des modèles de fondation se démocratise rapidement. Les alternatives crédibles aux modèles d'OpenAI ou d'Anthropic se multiplient, avec des profils prix/performance de plus en plus attractifs. Il est temps d'intégrer cette diversité dans les choix d'architecture.

Source originale : The Decoder — Xiaomi launches three MiMo AI models to power agents, robots, and voice

Articles similaires